Por Maryam Qarehgozlou

La información fue proporcionada al sitio web Drop Site por informantes, quienes expusieron detalles operativos de la llamada “Organización de Integridad” de Meta, un departamento que afirma garantizar la seguridad y autenticidad en sus plataformas, incluidas Facebook e Instagram.

Los datos filtrados revelan que el régimen israelí —conocido como “el mayor generador de solicitudes de eliminación de contenido a nivel mundial”— destaca por su éxito en censurar discursos críticos, mientras que apenas el 1,3 % de sus solicitudes afectan a usuarios israelíes.

Esta información confirma que el conglomerado tecnológico estadounidense ha acatado las órdenes del régimen israelí para llevar a cabo lo que ya se califica como “la mayor operación de censura masiva en la historia moderna”, dirigida principalmente contra usuarios de países árabes y de mayoría musulmana.

En total, usuarios de más de 60 países han denunciado la censura de contenido relacionado con Palestina. Los 12 países más afectados son, en orden: Egipto, Jordania, Palestina, Argelia, Yemen, Túnez, Marruecos, Arabia Saudí, Líbano, Irak, Siria y Turquía.

Las medidas de censura han incluido la eliminación de publicaciones, suspensión de cuentas y la práctica del shadow banning, que reduce la visibilidad de las publicaciones consideradas críticas hacia el régimen asesino de niños en Tel Aviv.

Las solicitudes de eliminación de contenido (Takedown Requests, TDRs) permiten que individuos, organizaciones y funcionarios gubernamentales pidan la eliminación de publicaciones bajo el pretexto de supuestas “violaciones de políticas”, cuya definición es deliberadamente ambigua.

Los datos revelan que Meta ha eliminado más de 90.000 publicaciones en cumplimiento con las solicitudes de eliminación (TDRs) del régimen israelí, en un promedio de apenas 30 segundos desde los acontecimientos del 7 de octubre de 2023.

Desde esa fecha, Meta también ha incrementado significativamente las eliminaciones automatizadas, tras el estallido de la guerra genocida de Israel contra Gaza. Esto ha resultado en un estimado de 38,8 millones de publicaciones “intervenidas” adicionales en Facebook e Instagram desde finales de 2023.

El término “intervenidas”, según la jerga de Facebook, se refiere a publicaciones que han sido eliminadas, bloqueadas o suprimidas en su visibilidad.

Si bien los usuarios comunes pueden reportar contenido mediante la función integrada de la plataforma —normalmente revisada por inteligencia artificial—, los gobiernos y organizaciones cuentan con canales privilegiados para solicitar revisiones de contenido, que reciben mayor prioridad y son revisadas casi siempre por moderadores humanos, no por sistemas automatizados.

Las TDRs presentadas por gobiernos tienen una probabilidad significativamente mayor de derivar en la eliminación de contenido.

Las revisiones humanas alimentan el sistema de inteligencia artificial de Meta, lo que permite afinar su capacidad para evaluar y moderar contenido similar en el futuro.

Sin embargo, según los informantes, Meta hace una excepción con el régimen israelí: elimina publicaciones sin ningún tipo de revisión humana, aunque aún así utiliza esos datos para entrenar su inteligencia artificial.

De acuerdo con fuentes internas de Meta, el proyecto de censura de Israel —que reprime publicaciones en Instagram y Facebook críticas con Israel o incluso levemente solidarias con los palestinos— tendrá consecuencias duraderas. El sistema de IA que Meta está entrenando para moderar contenido se alimenta de los datos de estas eliminaciones exitosas de publicaciones críticas con el genocidio israelí, lo que podría sesgar las decisiones futuras en contra de las voces pro-Palestina.

Informes citan fuentes dentro de la Organización de Integridad de Meta que confirman que las revisiones internas de su sistema automatizado de moderación revelaron la eliminación frecuente de contenido propalestino o crítico de Israel que no violaba las políticas de Meta.

En otros casos, contenido propalestino que simplemente debería haber sido eliminado recibió una “advertencia” o strike, lo cual indica una infracción más grave. La acumulación de estas advertencias en una misma cuenta puede llevar a su eliminación total de las plataformas de Meta.

Los vínculos de la cúpula de Meta con el régimen israelí

La Organización de Integridad de Meta está encabezada por Guy Rosen, un exoficial militar israelí con experiencia en la Unidad 8200, la tristemente célebre rama de inteligencia de señales del régimen israelí.

Según empleados de la compañía, el equipo de Rosen trabaja en estrecha colaboración con la Organización de Políticas de Meta, que es la encargada de establecer las reglas que determinan qué contenido puede permanecer en la plataforma y cuál debe ser eliminado.

La Organización de Políticas está dirigida por Joel Kaplan, exfuncionario de la administración Bush, quien ha colaborado previamente con autoridades israelíes en iniciativas para combatir la llamada “incitación en línea”.

Por su parte, Jordana Cutler, directora de Políticas Públicas de Meta para Israel y la Diáspora Judía, fue una alta funcionaria del régimen israelí y asesora del primer ministro Benjamín Netanyahu.

Cutler también ha utilizado su cargo dentro de la compañía para identificar y señalar contenido pro-Palestina.

A pesar de que, según informantes, Meta conoce desde hace al menos siete años las tácticas de censura agresiva por parte de Israel, la empresa no ha abordado el problema de forma efectiva.

Por el contrario, Meta ha “proporcionado activamente al régimen israelí una vía legal para ejecutar su campaña de censura masiva”, lo que evidencia la falta de compromiso de la plataforma con una moderación de contenido justa e imparcial.

Silenciamiento sistemático del contenido pro-Palestina

Las acciones de Meta revelan una preocupante discriminación en el trato hacia los usuarios palestinos y el contenido relacionado con Palestina, especialmente si se compara con la moderación de publicaciones en hebreo o con la respuesta de la plataforma ante el conflicto entre Rusia y Ucrania.

En septiembre del año pasado, el grupo palestino de derechos digitales 7amleh publicó un informe titulado “Derechos digitales palestinos, genocidio y responsabilidad de las grandes tecnológicas”, tras casi un año de genocidio en Gaza.

El informe reveló el uso generalizado de la tecnología para cometer y agravar violaciones de derechos humanos, tanto por parte del régimen israelí como de las empresas tecnológicas vinculadas a este.

Según el informe, Israel ha empleado inteligencia artificial para atacar a palestinos, mientras que las grandes corporaciones tecnológicas han contribuido activamente a la censura, la supresión de información y la facilitación indirecta de las acciones del régimen israelí en medio del genocidio en curso en Gaza.

La plataforma 7or, de 7amleh, documentó más de 5.100 casos de censura digital y difusión de contenido dañino en plataformas como Meta y X entre el 7 de octubre de 2023 y septiembre de 2024.

La propagación de desinformación ha socavado la libertad de expresión, el acceso a la información y el derecho a la seguridad.

La manipulación informativa se ha utilizado para justificar el castigo colectivo contra los palestinos, obstaculizar los esfuerzos de ayuda humanitaria y agravar el riesgo de hambruna para los 2,3 millones de personas que viven bajo asedio en la Franja de Gaza.

Las conclusiones del informe también revelaron que ciertas plataformas en línea —incluida Facebook, propiedad de Meta— han obtenido beneficios económicos mediante publicidad con contenido nocivo.

De forma especialmente alarmante, Facebook difundió anuncios dirigidos que promovían el asesinato de individuos y respaldaban el desplazamiento forzoso de palestinos desde Cisjordania hacia Jordania.

Represión digital del contenido relacionado con Palestina

Durante los últimos 18 meses, organizaciones de derechos humanos y activistas han documentado incontables casos de represión digital contra contenido palestino o relacionado con Palestina, especialmente en las plataformas de Meta.

La cineasta palestino-estadounidense Khitam Jabr, quien había publicado algunos Reels en Instagram sobre el viaje de su familia a la Cisjordania ocupada antes del inicio de la guerra genocida israelí contra Gaza el 7 de octubre de 2023, denunció que, días después del estallido de la guerra, Instagram le restringió la posibilidad de publicar o transmitir en vivo durante 24 horas, tras ser reportados sus videos de viaje a Palestina por otros usuarios.

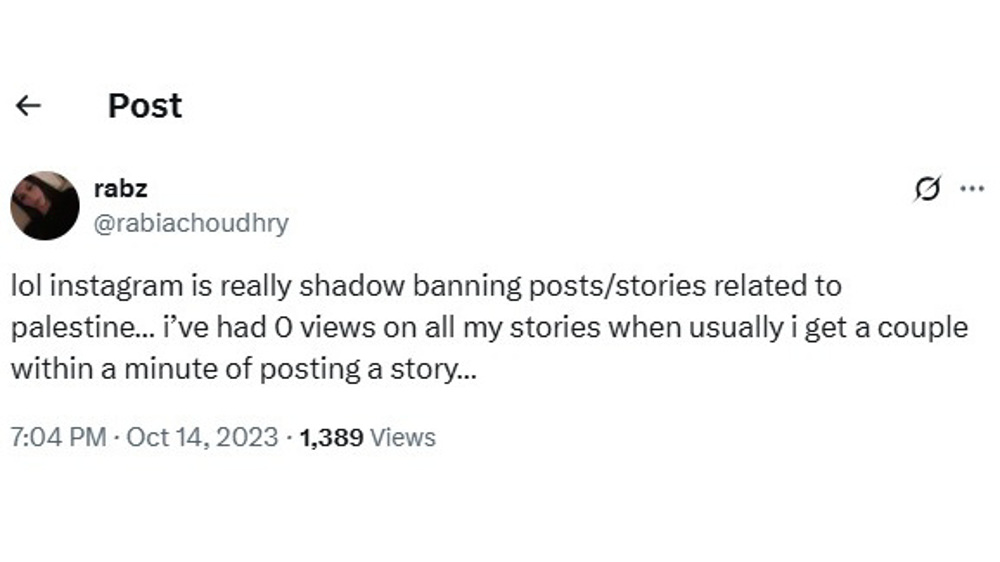

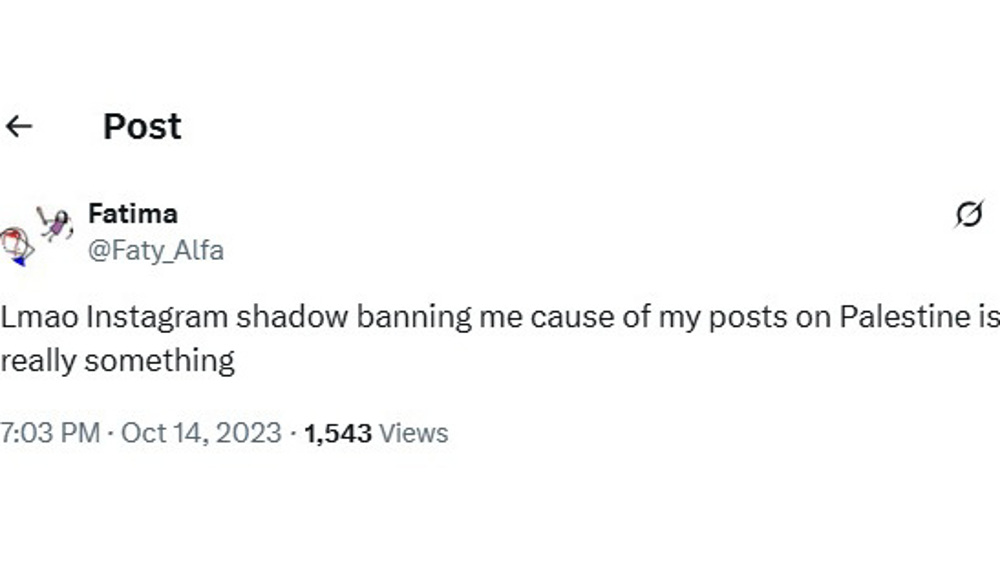

En los primeros días de la devastadora guerra, muchos usuarios de Instagram informaron que Meta estaba aplicando shadowbanning a sus publicaciones e historias sobre Palestina.

El shadowbanning es una práctica encubierta que emplean algunas plataformas de redes sociales para restringir la visibilidad de las publicaciones sin notificar al usuario, con el objetivo principal de evitar que se utilicen estos espacios para la defensa de determinadas causas.

Esta práctica limita la exposición del contenido en distintas funciones de la plataforma, como la pestaña Explorar, el Feed y los Reels. En algunos casos, incluso puede impedir que el contenido afectado sea encontrado mediante la función de búsqueda.

En su momento, Meta negó estar aplicando shadowbanning y atribuyó los problemas de visibilidad a “un error que afectó a todas las historias que volvían a compartir publicaciones del Feed y Reels”.

“Este error afectó por igual a cuentas de todo el mundo y no tuvo relación con el contenido de las publicaciones. Lo solucionamos lo más rápido posible”, afirmó la empresa.

Sin embargo, cientos de usuarios de Instagram reportaron que sus publicaciones destinadas a generar conciencia sobre la situación en Gaza tuvieron una interacción significativamente menor, lo que sugiere que fueron objeto de shadowbanning, mientras que sus otras publicaciones, no relacionadas con Gaza, mantenían niveles de interacción normales.

Una usuaria de Instagram, Jess White, por ejemplo, recurrió a la plataforma para volver a publicar en su historia un poema de una escritora palestina, y afirmó que fue “definitivamente víctima de shadowbanning”.

El poema en cuestión hablaba sobre la vida y la muerte de los niños durante la guerra.

“Normalmente obtengo unas 1.000 visualizaciones en mis historias, y cuando compartí una publicación con la ubicación en Gaza, solo tuve tres visualizaciones en 10 minutos”, declaró a medios de comunicación. “Cuando publiqué algo no relacionado unas horas después, las visualizaciones volvieron a subir”.

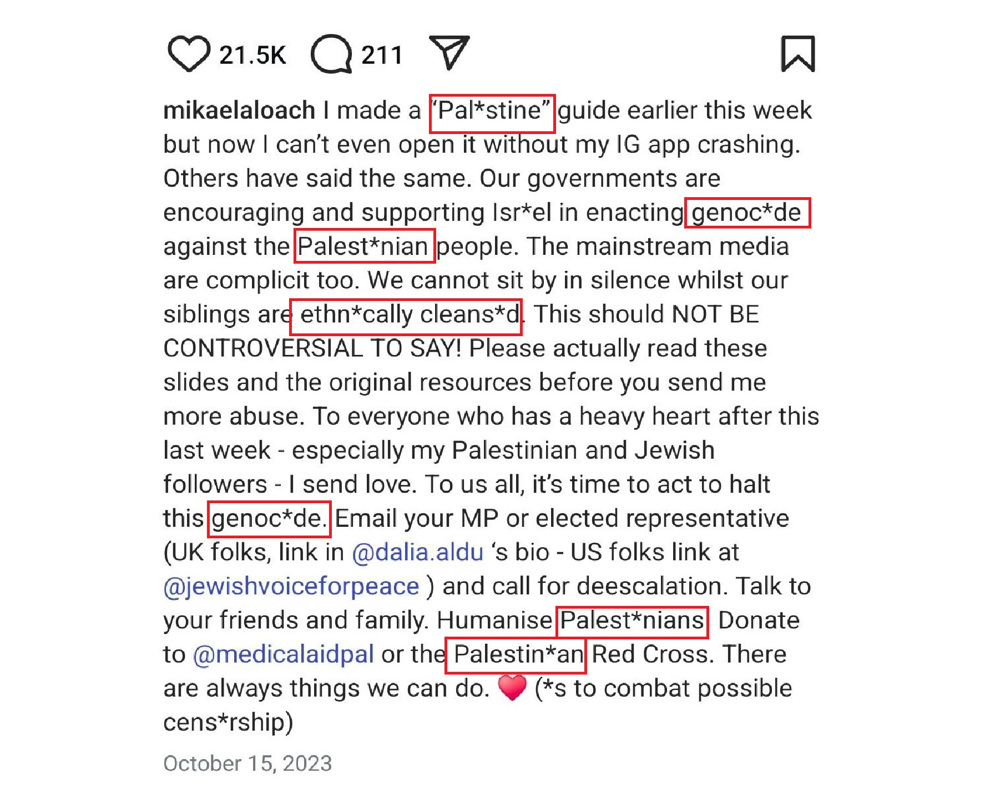

Como respuesta a los implacables ataques israelíes contra Gaza en sus primeras semanas, numerosos influenciadores y cuentas comenzaron a emplear estrategias indirectas para mantener la visibilidad en Instagram, como incluir hashtags a favor de Israel en sus publicaciones.

Algunos usuarios señalaron que el uso de estos hashtags incrementó significativamente las visualizaciones de su contenido propalestino.

Otros, al publicar sobre Palestina, optaron por escribir ciertas palabras con asteriscos para evitar posibles impactos negativos en la visibilidad de sus publicaciones.

Incluso hubo quienes incluyeron GIFs de la “bandera israelí” en el fondo de sus historias, con la esperanza de que el algoritmo de la plataforma favoreciera la exposición de su contenido.

A pesar de estos esfuerzos, los problemas de censura persistieron. A finales de octubre de 2023, aproximadamente tres semanas después del inicio de la implacable campaña de bombardeos israelíes contra la Franja de Gaza, 7amleh informó que los comentarios de Instagram que contenían el emoji de la bandera palestina estaban siendo ocultados.

Numerosos usuarios informaron a 7amleh que sus comentarios habían sido desplazados al final de la sección de comentarios, requiriendo un clic adicional para ser visibles.

Según Eric Sype, organizador de 7amleh en EE. UU., muchos de estos comentarios tenían algo en común: “A menudo parecía coincidir con la presencia de una bandera palestina en el comentario.”

Los usuarios también notificaron a 7amleh que Instagram había marcado y ocultado comentarios que contenían el emoji como “potencialmente ofensivos”.

Meta ha atribuido frecuentemente casos similares de censura a fallos técnicos; sin embargo, el portavoz de Meta, Andy Stone, confirmó en ese momento que la empresa estaba ocultando comentarios con el emoji de la bandera palestina en contextos específicos que consideraba "ofensivos" y que violaban sus normas.

Sin embargo, algunos de los comentarios ocultos revisados por The Intercept solo contenían emojis y ningún otro texto.

Un ejemplo incluyó un usuario comentando en un video de Instagram de una manifestación pro-palestina en Jordania usando emojis de corazones representando los colores de la bandera palestina, junto con emojis de las banderas de Marruecos y Palestina. En otro caso, un usuario publicó solo tres emojis de la bandera palestina.

Otra captura de pantalla vista por The Intercept reveló dos comentarios ocultos que solo contenían los hashtags #Gaza, #gazaunderattack, #freepalestine y #ceasefirenow.

Instagram también tradujo automáticamente las biografías de los usuarios que contenían la palabra “palestino” y la frase árabe “Alhamdullilah” (que significa “Alabado sea Dios”) como “Los terroristas palestinos luchan por su libertad.”

Además, la empresa redujo el umbral de certeza para “ocultar” contenido hostil del 80% al 25% en el caso de contenido originado en gran parte de Asia Occidental, con el fin de frenar la propagación del discurso hostil. Sin embargo, esto podría dar lugar a restricciones demasiado amplias sobre el contenido.

Mientras tanto, el discurso de odio, la incitación a la violencia, la deshumanización y los llamados al genocidio contra los palestinos abundan en la plataforma.

En otro movimiento alineado con la ocupación israelí, Facebook eliminó la página de Quds News Network, la página palestina más grande con casi 10 millones de seguidores, impidiendo efectivamente que informara sobre las noticias palestinas y expusiera los crímenes de la ocupación.

Según los usuarios, esta acción demostró el aparente apoyo de Facebook a la agenda del régimen israelí y contribuyó a la supresión de las voces palestinas en el panorama mediático.

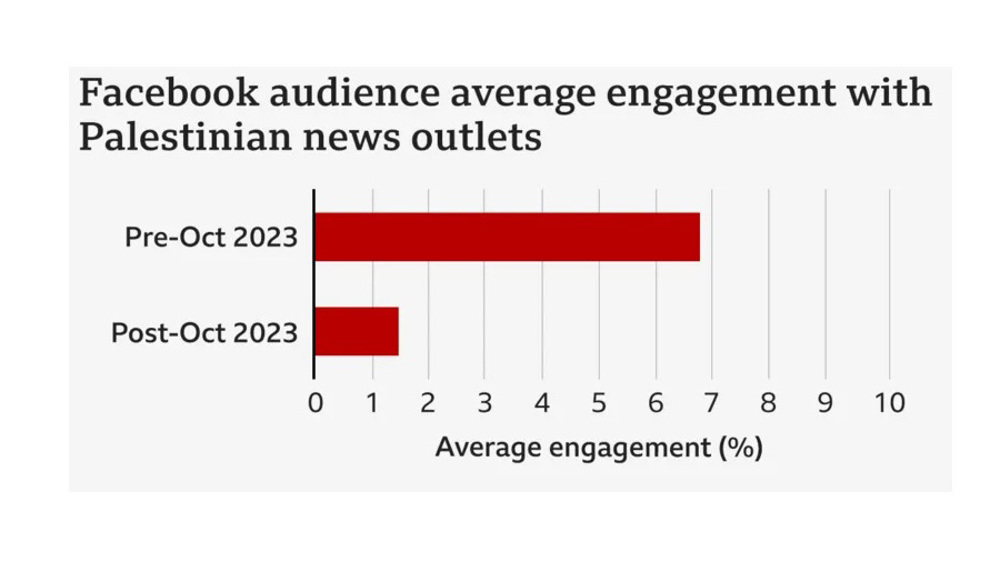

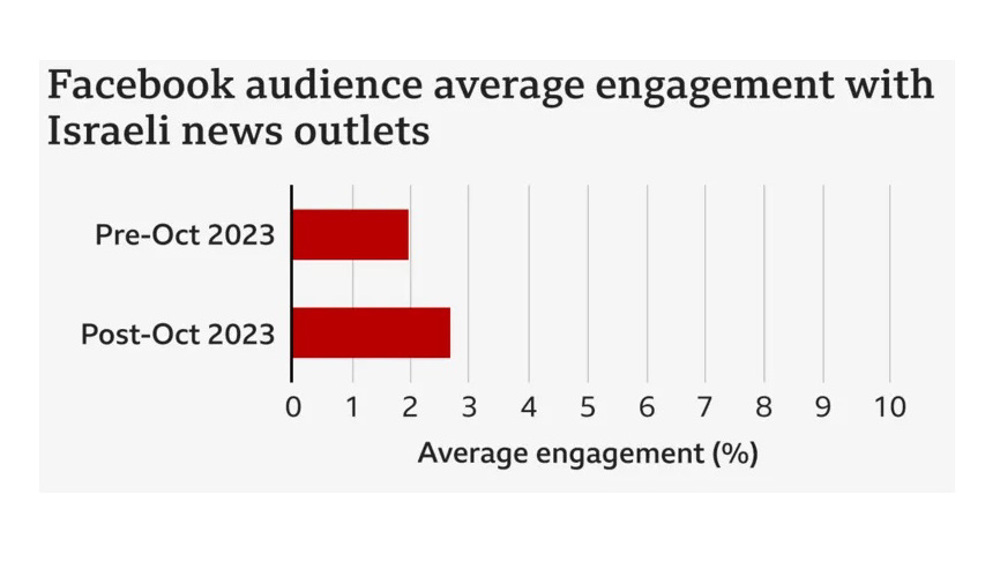

Otro análisis de datos de Facebook en diciembre de 2024 reveló una disminución significativa en la interacción de la audiencia con los medios de noticias palestinos desde octubre de 2023.

El estudio examinó los datos de interacción de 20 importantes medios de noticias palestinos, incluidos Palestine TV, la agencia de noticias WAFA y Palestinian Wattan News, comparando el año previo a la operación de Hamas del 7 de octubre con el año siguiente.

Sorprendentemente, a pesar de las expectativas de un aumento en la interacción durante un periodo de guerra, los datos mostraron una caída del 77 por ciento tras la Operación Al-Aqsa Flood.

Por el contrario, la BBC realizó el mismo análisis de datos en las páginas de Facebook de 20 organizaciones de noticias israelíes, como Yediot Ahronot, Israel Hayom y Channel 13, que también publicaron contenido sustancial relacionado con la guerra. La interacción de su audiencia aumentó en casi un 37 por ciento.

Los documentos filtrados en ese momento también indicaron que Instagram intensificó su moderación de los comentarios de los usuarios palestinos después de octubre de 2023.

Una fuente anónima compartió documentos internos que revelaban un cambio en el algoritmo de Instagram, lo que resultó en una moderación más agresiva de los comentarios realizados por palestinos.

“Dentro de una semana del ataque de Hamas, el código fue modificado, lo que lo hizo más agresivo hacia el pueblo palestino”, dijo la fuente.

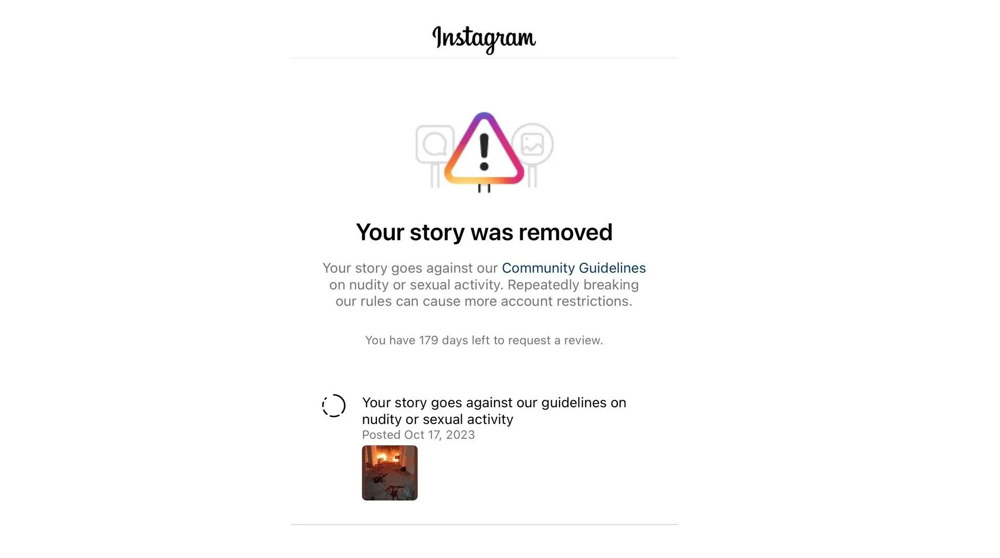

El 17 de octubre de 2023, después de un ataque israelí al hospital Al-Ahli en la Franja de Gaza, los usuarios de Meta que compartieron una imagen de las devastadoras consecuencias tuvieron sus publicaciones eliminadas o se les pidió que las retiraran debido a supuestas violaciones de las políticas que prohíben “la desnudez o actividad sexual”.

Sin embargo, la imagen en cuestión, que mostraba lo que parecía ser el exterior en llamas del hospital, donde un hombre vestido yacía junto a un charco de sangre, con el torso ensangrentado, no parecía encajar en esa categoría.

En un caso, un usuario fue notificado de que Instagram había eliminado su publicación debido a la prohibición de la plataforma de “mostrar los genitales o las nalgas de alguien” o de “implicar actividad sexual”.

En otra captura de pantalla, un usuario de Facebook que compartió la misma imagen fue informado de que su publicación había sido cargada, “pero parece similar a otras publicaciones que fueron eliminadas porque no siguen nuestros estándares sobre desnudez o actividad sexual.” Al usuario se le pidió que eliminara la publicación.

Estos incidentes parecen contradecir las políticas anteriores de la empresa, que protegían la publicación de escenas violentas pero noticiosas que muestran víctimas civiles.

Meta había instruido previamente a sus moderadores, a través de un lenguaje interno en sus políticas, a no eliminar la documentación de los ataques aéreos rusos contra civiles ucranianos.

Sin embargo, no hay indicios de que a los palestinos se les haya concedido una excepción similar a las políticas de moderación de contenido.

Texto recogido de un artículo publicado en Press TV.